在本文截稿时,Clawdbot官方已经宣布更名为MoltBot,如果接下来你在其它地方看到MoltBot,那也是它。

前言:这两天它太火了,不用焦虑,先看看我的体验

上个月在 X 上就刷到过 Clawdbot 的讨论,那时候 Claude Cowork 都还没出。

说实话,第一眼看到这个项目时,我有点怀疑:又是哪个轮子?

真正让我决定试试的,是 Youtube 上看到一个硅谷的博主推荐,他专门买了个mac mini来跑。

于是我在一台老 Intel MacBook 上装了 Clawdbot。(先说,不用另买mac mini,老mac/vps/树莓派/WSL2都行。至于为什么不推荐在主力电脑上安装,主要是因为它权限太高,容易把你的工作环境弄坏。)

然后就开始踩坑。

官方的安装命令在 macOS 11.7 上直接编译失败,Node.js 依赖各种报错。折腾了一晚上,最后手动装了 nvm 和 Node.js 22.0 搞定。

如果你也遇到了同样的问题,直接跳到「安装前准备」那一节,我写了详细的解决方案。

装完之后,我真香了。

一、Clawdbot 到底是什么?

Clawdbot 本质上是一个基于 CLI 的桌面 Agent,但它打通了 Telegram、WhatsApp 这些消息服务。

啥意思呢?

你可以在手机上给 Telegram 发一条消息,家里的电脑就开始干活了。

和 Claude Code 的核心区别:

| 特性 | Clawdbot | Claude Code |

|---|---|---|

| 消息集成 | ✅ Telegram/WhatsApp/Discord等 | ❌ 无 |

| 远程控制 | ✅ 随时随地 | ❌ 只能本地 |

| 记忆系统 | ✅ 改进版 | 会话级 |

| 本地权限 | ✅ 更多 | 受限/请求授权 |

| 费用 | ✅ 使用现有订阅(ChatGPT/GLM等) | Cowork 需会员 |

说白了,它就是一个「随时能联系上的 AI 助手」。

二、安装前准备(重要!)

前置要求

- Node.js >= 22(注意版本!)

- macOS / Linux / Windows (WSL2)

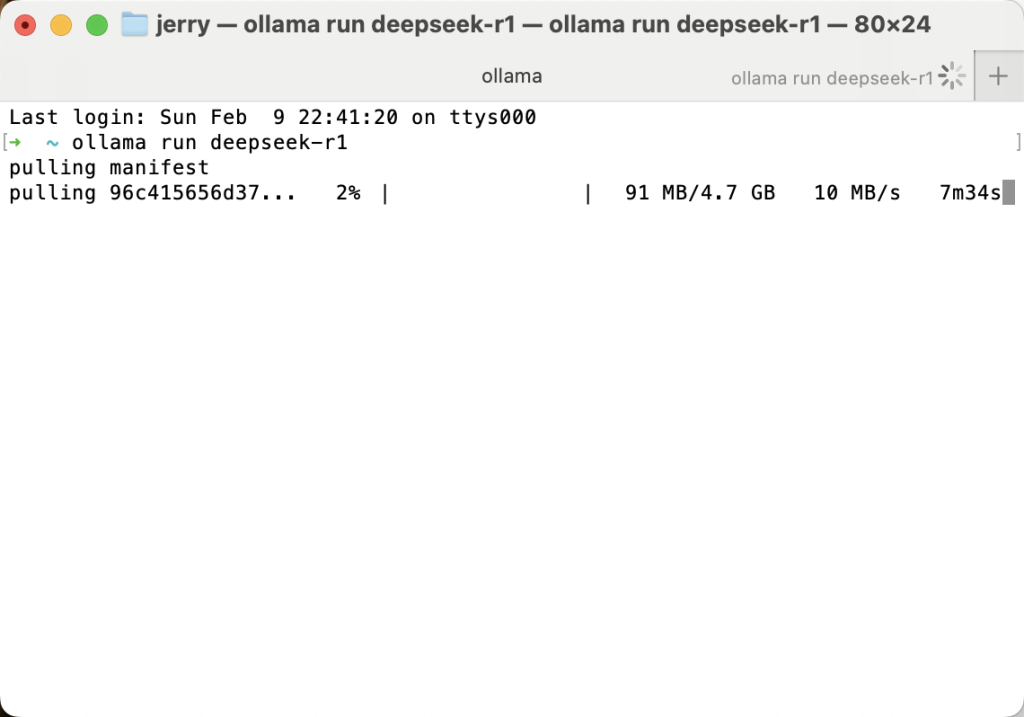

⚠️ 常见坑:Node.js 版本问题

如果你用的是老版本 macOS(11.7 或更早),官方安装命令大概率会失败。

我的报错是这样的:

gyp ERR! build error

gyp ERR! stack Error: `make` failed with exit code: 2解决方案:手动安装 Node.js 22

# 1. 安装 nvm

curl -o- https://raw.githubusercontent.com/nvm-sh/nvm/v0.39.0/install.sh | bash

# 2. 重新加载终端配置

source ~/.bashrc # 或者 source ~/.zshrc

# 3. 安装 Node.js 22

nvm install 22

nvm use 22

# 4. 验证版本

node --version # 应该显示 v22.x.x为啥不用官方的 Node.js 安装包?

因为老版本 macOS 上,某些原生依赖编译不过。官方安装包24+在老版本上也不支持。nvm 会下载预编译的二进制文件,直接绕过这个问题。

三、快速安装(10 分钟)

官方安装命令

curl -fsSL https://clawd.bot/install.sh | bash或者用 npm:

npm install -g clawdbot@latestWindows 用户(PowerShell):

iwr -useb https://clawd.bot/install.ps1 | iex验证安装

clawdbot --version如果能看到版本号,说明安装成功了。

四、配置向导(3 分钟)

Clawdbot 提供了一个 onboarding wizard,会一步步引导你配置:

clawdbot onboard --install-daemon向导会让你选择:

1. Gateway 模式

- Local(推荐):Gateway 运行在本机,适合个人使用

- Remote:Gateway 运行在远程服务器,适合 24/7 运行

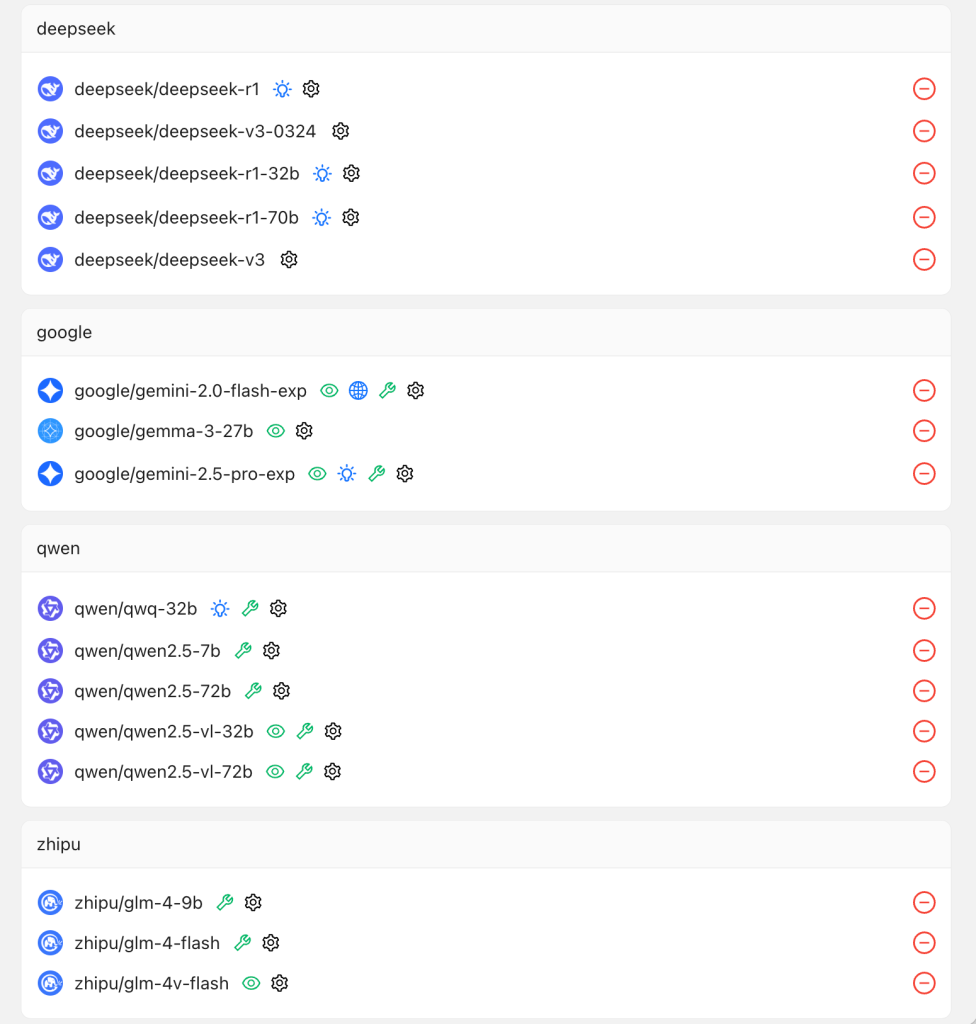

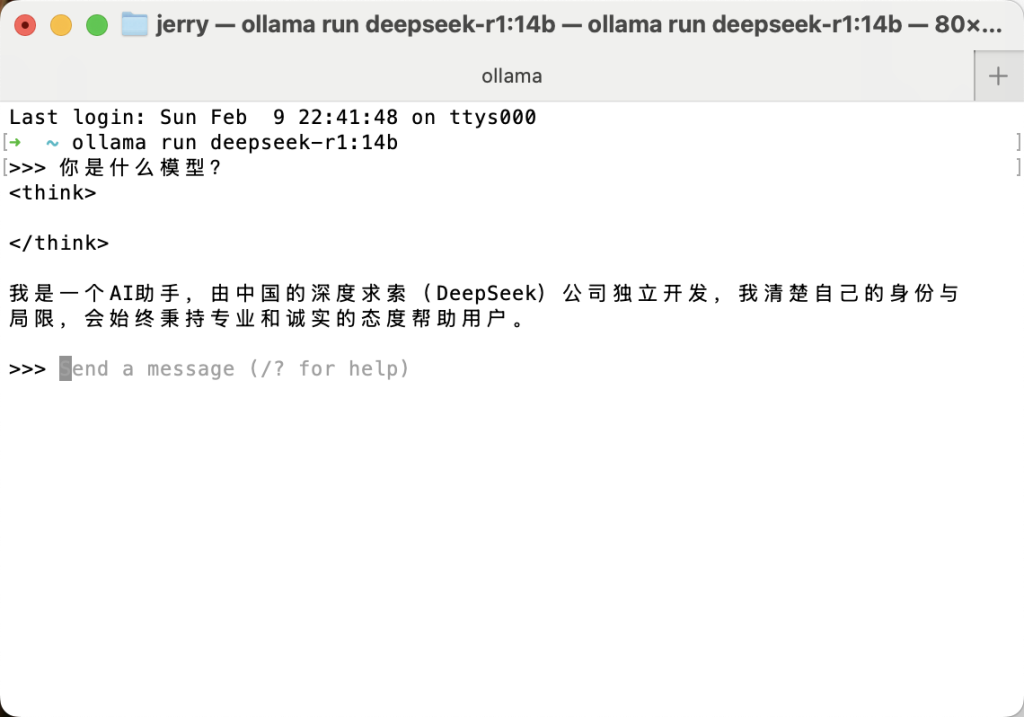

2. 模型和授权

- OpenAI OAuth(推荐):登录 ChatGPT 授权即可

- API Key:使用自己的 API Key(支持 OpenAI/Anthropic/其他)

我用的是 GPT-4,直接用 ChatGPT 登录授权就行。

3. 消息渠道配置

- WhatsApp:扫码登录(类似微信网页版)

- Telegram:创建 Bot 并输入 Token

- Discord:创建 Bot 并输入 Token

强烈推荐先用 Telegram 试手,因为配置最简单。

4. 后台服务

向导会问你要不要安装后台服务(launchd/systemd),建议选 Yes。

这样 Clawdbot 会开机自启动,不用每次手动运行。

五、连接 Telegram(核心功能)

第一步:创建 Telegram Bot

- 在 Telegram 里搜索

@BotFather - 发送

/newbot - 按提示输入 Bot 名称(比如

MyClawdbot) - BotFather 会给你一个 Token,类似这样:

1234567890:ABCdefGHIjklMNOpqrsTUVwxyz复制这个 Token,一会要用。

第二步:在 Clawdbot 中配置

如果你用了 onboarding wizard,直接在向导里输入 Token 就行了,超简单。

如果已经完成了向导,想手动加一个 Telegram Bot,可以这样:

# 编辑配置文件

nano ~/.clawdbot/clawdbot.json添加 Telegram 配置:

{

"channels": {

"telegram": {

"token": "你的_Bot_Token"

}

}

}第三步:启动 Gateway

clawdbot gateway --port 18789 --verbose如果安装了后台服务,Gateway 应该已经在运行了。可以用这个命令检查:

clawdbot status第四步:第一次对话

- 在 Telegram 里搜索你刚创建的 Bot

- 发送任意消息,比如

hello

重点来了:第一次对话会返回一个 pairing code(配对码)。

别慌,这是正常的。Clawdbot 默认开启安全模式,陌生 DM 需要手动批准。

批准配对:

clawdbot pairing approve telegram <配对码>然后你再发一条消息,Bot 就会正常回复了。

六、验证和使用

检查状态

# 查看 Gateway 状态

clawdbot status

# 健康检查

clawdbot health

# 安全审计

clawdbot security audit --deep打开 Dashboard

Clawdbot 提供了一个 Web 控制面板:

clawdbot dashboard然后在浏览器打开 http://127.0.0.1:18789/

你可以在 Dashboard 里:

- 查看所有会话

- 发送测试消息

- 配置 Agent

- 查看日志

远程控制

现在你可以:

在手机上给 Telegram Bot 发消息:

帮我看看 ~/Documents 里有什么文件家里的电脑就会执行这个命令,然后把结果发回给你。

这太爽了。

七、实用技巧

1. 保持 Gateway 持续运行

如果你用的是 macOS,后台服务会自动管理。

如果想手动启动:

# 前台运行(调试用)

clawdbot gateway --verbose

# 后台运行

clawdbot gateway --daemon2. 查看日志

# 实时查看日志

tail -f /tmp/clawdbot/gateway.log

# 或者用 clawdbot 命令

clawdbot logs --follow3. 配置文件位置(记一下,有用)

- 主配置:

~/.clawdbot/clawdbot.json - 工作区:

~/clawd(存放你的 skills、prompts、memories) - 凭证:

~/.clawdbot/credentials/ - 会话历史:

~/.clawdbot/agents/<agentId>/sessions/

4. 更新 Clawdbot

# 如果你用的是安装脚本

curl -fsSL https://clawd.bot/install.sh | bash

# 如果你用的是 npm

npm update -g clawdbot@latest八、常见问题

Q1: Telegram Bot 不回复?

原因 1:没批准配对码(最常见)

clawdbot pairing list telegram

clawdbot pairing approve telegram <配对码>原因 2:Gateway 没运行

clawdbot status

# 如果显示 "stopped",启动它

clawdbot gateway --daemon原因 3:没配置模型授权

clawdbot onboard # 重新配置模型和授权Q2: 如何更换模型?

编辑配置文件:

nano ~/.clawdbot/clawdbot.json修改模型配置:

{

"models": {

"defaults": {

"provider": "openai",

"model": "gpt-5.2" // 或其他模型

}

}

}然后重启 Gateway:

clawdbot gateway restartQ3: 能同时在多个渠道用吗?

可以。

Clawdbot 支持同时连接 WhatsApp、Telegram、Discord 等多个渠道,想配几个配几个。

配置方式都和 Telegram 类似,在 onboarding wizard 里依次配置就行了。

九、为什么我现在介绍它?

和 Claude Code 对比

| 场景 | Clawdbot | Claude Code |

|---|---|---|

| 远程任务 | ✅ 手机随时发任务 | ❌ 必须在电脑前 |

| 24/7 待命 | ✅ 家里电脑一直开着 | ❌ 同上 |

| 消息集成 | ✅ Telegram/WhatsApp | ❌ 无 |

| 编程能力 | ✅ 完整文件操作 | ✅ 同样强大 |

| Skills 生态 | ✅ 兼容 MCP | ✅ 更成熟 |

我的结论:

- 如果你主要在电脑前用 Claude Code,继续用就行

- 如果你需要远程控制、随时发任务,Clawdbot 更香

和豆包手机对比

这是两个不同的技术路线:

| Clawdbot | 豆包手机 | |

|---|---|---|

| 路线 | CLI Agent | GUI Agent |

| 操作方式 | 命令行 | 图形界面 |

| 适用场景 | 开发者、系统操作 | 普通用户、手机操作 |

它们不是竞争关系,而是互补。

我相信未来会出现两者结合的方案。

十、适合谁用?

✅ 推荐人群

- 需要远程控制电脑的开发者

- 随时随地查看服务器状态

- 手机上发任务,家里电脑执行

- 重度 Telegram/WhatsApp 用户

- 喜欢在聊天软件里直接操作

- 不想切换到专门的 AI 应用

- 对 Claude Code 的限制不满的人

- Cowork 要付费

- 想要更多本地权限

- 需要更好的记忆系统

- 喜欢折腾的技术爱好者

- 愿意花时间配置

- 想要完全掌控自己的 AI 助手

❌ 不推荐人群

- 完全不熟悉命令行的用户

- 虽然有向导,但还是需要一点 CLI 知识

- 可以先学学命令行基础

- 只需要偶尔用 AI 的人

- 如果只是偶尔问问题,ChatGPT 网页版就够了,别折腾

- 够用就好

- 对隐私极度敏感的人

- Clawdbot 需要授权访问文件系统

- 虽然是本地运行,但如果你很在意这个,要考虑清楚

- 安全第一

十一、最后:我的真实体验

装好 Clawdbot 之后,我最大的感受是:

随时能联系上的 AI,真的不一样。不是一点点的不同,是「完全不同物种」的那种不一样。

以前用 Claude Code,我得:

- 打开电脑(如果电脑没开的话)

- 打开终端

- 输入命令

- 等结果

现在用 Clawdbot:

- 掏出手机,Telegram 发一条消息

- 该干嘛干嘛,等它干完活通知我

体验完全不同。

听起来好像差别不大?

但你试过在外面突然想起来「哎呀,家里有个脚本没跑」,掏出手机就能操作,就知道有多爽了。

而且它本身完全开源且免费,用你现有的AI订阅连接上即可。

如果你之前对 Claude Code、Claude Cowork 又爱又恨,那 Clawdbot 值得认真试一试。

十二、快速开始

安装(10 分钟左右,需要本地编译依赖):

curl -fsSL https://clawd.bot/install.sh | bash配置向导(3 分钟):

clawdbot onboard --install-daemon启动 Gateway:

clawdbot gateway --daemon然后在 Telegram 上给你的 Bot 发第一条消息。

试试看,你会有惊喜。

参考资源

- 官方文档:https://docs.clawd.bot/

- GitHub 仓库:https://github.com/clawdbot/clawdbot

- Reddit 讨论:Clawdbot: the full setup in 30 minutes

- Medium 教程:How to Set Up Clawdbot

作者的话:这篇文章是基于我的真实安装经历写的。如果你在安装过程中遇到问题,欢迎在评论区交流。